认识 XAI Router

Posted July 3, 2025 by XAI 产品团队 ‐ 19 min read

它不只是 AI API Router,更是企业 AI 生产力的调度中枢。

今天企业引入 AI,已经不是“能不能接一个大模型 API”的问题,而是“如何把 AI 变成一套可分发、可治理、可审计、可优化的生产力系统”。

这也是为什么越来越多老板和管理层开始把注意力从“哪个模型更聪明”转向“团队到底在怎么用 AI、花了多少钱、Key 有没有泄露、哪些部门产出更高、哪些请求应该用便宜模型、哪些场景必须走高质量模型”。

从近期公开研究看,这几个痛点已经非常明确:

- 微软 2024 Work Trend Index 显示,75% 的知识工作者已经在工作中使用 AI,其中 78% 是员工自带工具(BYOAI)。这意味着很多企业在正式治理之前,AI 实际上已经先一步进入了组织内部。

- 微软 2025 Work Trend Index 提到,管理者一边面临生产率压力,一边又缺少足够人力与精力去消化新增工作,AI 因此从“试验项目”变成了“组织能力建设”。

- IBM 2025 CEO Study 显示,只有 25% 的 AI 项目达到了预期 ROI,只有 16% 在企业范围内完成规模化落地。很多公司不是不想做,而是卡在治理、预算、集成和运营上。

- Deloitte 2025 董事会调研指出,只有四分之一的受访者满意当前 AI 落地速度,近三分之一的组织仍然没有准备好部署 AI,而风险与治理仍然是短板。

所以,XAI Router 的真正价值,并不只是“帮你转发请求”,而是把企业里零散的 AI 访问行为,收束成一个统一的控制平面与运行平面。

宏观架构:不是一层代理,而是三层协同

从产品架构上看,XAI 更适合被理解为三层协同的多组件体系:

- 控制面(Control Plane):负责主/子账户体系、策略配置、AI tokens 分发、额度与商品体系、账单统计、管理后台和员工使用视图。

- 路由运行面(Runtime Plane):负责模型映射、密钥池调度、速率限制、ACL、计费统计、异步落库与缓存体系。

- 协议桥接面(Bridge Plane):负责把 OpenAI 兼容流量、Claude Code、Codex Responses、Gemini Native API 等不同协议,转换成统一可治理的企业入口。

这三层叠在一起,企业拿到的就不再是一个“代理地址”,而是一套完整的 AI 资源操作系统。

1. 高性能与可扩展性:先保证它能承接真实组织流量

XAI Router 的热路径不是围绕“演示调用”设计的,而是围绕真实团队的日常高频使用设计的。

- Rust 异步运行时:核心网关与桥接组件都建立在 Rust 异步架构上,目标是降低尾延迟、提高吞吐,并在同等机器资源下压缩运行成本。

- 严格分层的缓存路径:在 XAI 的控制与路由体系中,用户、策略、

ModelMapper、LevelMapper等高频状态遵循“先内存、再 Redis、最后数据库”的读取顺序。这不是普通实现细节,而是吞吐设计本身。 - 运行时 exact cache:

ModelMapper与LevelMapper在热路径上会把高频匹配结果沉淀为运行时精确缓存,减少重复 wildcard 匹配与重复计算。 - 无状态横向扩展:代理实例保持无状态,共享状态放在 Redis / PostgreSQL 等外部组件中,因此可以直接通过负载均衡横向扩容。

- 异步后台结算:日志、用量更新、统计聚合、账单写入等非必要同步动作,会尽量从请求主链路剥离到后台处理。

如果一个企业要让几百名员工、多个自动化任务、IDE 插件、内部应用和 Agent 一起共享 AI 资源池,性能不是锦上添花,而是基础生存条件。

2. 高可用与智能路由:把“模型可用”变成默认前提

企业真正怕的,不是单次慢一点,而是生产链路在高峰期突然不可用。

XAI Router 在可靠性上的设计重点,是把“单一 Key、单一模型、单一供应商”的脆弱性拆开:

- 轮询式密钥池:同一模型或同一等级可挂多个上游 Key,调度器按轮询或策略进行分发,降低单 Key 被限速的概率。

- 自动故障转移与透明重试:当上游出现

429或5xx等临时错误时,系统会自动切换到池中的下一个可用 Key 重试。 - 跨等级故障转移:当某个等级资源池整体不健康时,可以进一步切到备用等级,避免核心业务直接中断。

- 实时配置同步:新增 Key、更新模型映射、修改用户策略后,配置可以快速同步到整个集群,而不是依赖人工重启。

- 协议桥接容灾:面向 Codex、Claude、Gemini 等生态的桥接组件,让企业不用在每个客户端上分别处理 OpenAI、Anthropic、Google 等不同协议差异,而是在统一入口上做治理与切换。

对老板而言,这一层的意义很直接:AI 不再是某个员工电脑里“偶尔能用”的工具,而是可以进入客服、研发、分析、运营等主业务流程的稳定基础设施。

3. 协议桥接层:把 Codex、Claude、Gemini 变成统一企业入口

如果只支持“标准 OpenAI 接口”,那么企业在接入真实 AI 工具链时,很快又会回到碎片化状态。

当前这套架构的差异化之一,就是把不同生态的官方工具链也一起纳入统一治理:

- Codex 桥接组件:负责 Codex CLI / Responses 链路的代理与转换,支持 OpenAI 兼容接口、原生 Responses 透传、OAuth token 轮换、token cache,以及模型映射,在保证兼容性的同时提升会话与缓存协同效率。

- Claude 桥接组件:负责 Claude Code CLI、Claude API、Agent SDK 与 OpenAI 兼容入口之间的桥接,支持自动系统提示注入、流式转换与官方账号/Key 接入。

- Gemini 桥接组件:负责 Gemini Native API 与 OpenAI 风格聊天接口之间的兼容,支持统一转发、动态认证与多协议适配。

- 统一模型治理:桥接层不是孤立存在的。它们最终都挂接到 XAI Router 的统一策略入口上,使

allow_models、model_mapper、level_mapper、速率限制和账单统计能够跨供应商保持一致。

这意味着企业可以把“员工用什么 AI 工具”与“企业如何治理这些工具”分离开。前端工具可以多样化,后端治理必须统一化。

4. AI tokens 资源分发:把 AI 从“报销项”变成“可运营资源”

企业落地 AI 最容易失控的地方,不是模型质量,而是资源分发方式。

很多团队一开始的做法非常原始:谁需要就发一个 Key,谁超了就再补一个 Key。结果就是:

- 成本无法归因

- 预算无法提前分配

- 员工无法区分“日常额度”和“临时补量”

- 管理层看不到部门之间的资源结构

XAI Router 在这里做的,不是简单限流,而是把 AI tokens 资源做成可管理的企业配给体系:

- 主/子账户分发:主账户可以按组织结构向下创建子账户,把 AI 能力像预算一样分发到部门、项目组、员工。

- DNA 继承式组织结构:支持无限层级账户树,父级边界自动向下继承,下级可以收紧,但不能突破上级治理边界。

- 策略而不是裸额度:除了发额度,还可以一起下发

allow_models、model_mapper、level_mapper、角色、等级、日额度和速率限制。 - 商品化资源供给:XAI 将订阅、按量卡、扩展包、服务商品拆开,分别用于长期套餐、临时补量、附加资源和人工交付场景。

- 日配额与硬边界:

daily_limit、RPD、TPD、TPM 等限制可以同时存在,让企业既能控预算,也能控瞬时冲击。

从管理角度看,AI tokens 不应该被当作“模糊的 API 消耗”,而应该像云资源、带宽、SaaS license 一样,被视为一种可采购、可分配、可追踪、可回收的内部生产资料。

5. API Key 安全治理:Key 不是配置项,而是生产资产

绝大多数企业 AI 风险,最后都绕不开一个问题:API Key 到底掌握在谁手里。

如果每个员工都直接持有上游厂商 Key,那么企业会立刻遇到这些问题:

- Key 散落在脚本、IDE、浏览器插件和 CI 里

- 员工离职后难以确认哪些凭证仍可使用

- 不同部门共享同一个 Key,导致难以归因与审计

- 上游 Key 一旦泄露,很难通过调用边界阻断风险

XAI Router 的安全设计,核心就是把“能调用 AI”与“能接触上游密钥原文”拆开:

- BYOK 与统一托管:企业仍然使用自己的 Provider Key,但不必把 Key 分发给所有终端。

- 加密存储:上游凭证在持久层中以加密形式保存,降低数据库层面的泄露风险。

- 最小暴露原则:员工与子账户通常只拿到 XAI 的接入凭证,不直接接触 OpenAI、Anthropic、Google 等上游密钥。

- ACL 安全流水线:身份验证、IP 白名单、模型白名单、资源白名单、账号状态检查、额度校验按顺序执行。

- 桥接层 token 轮换能力:桥接组件还承担 OAuth token 刷新、缓存和安全转发的职责,降低官方账号接入场景下的运维摩擦。

对于很多老板来说,真正的诉求其实很朴素:不要让几十个员工各自保存一堆第三方 Key,更不要让财务发现账单暴涨时才知道某个 Key 已经泄露两周。

6. 统计、审计与员工日常使用洞察:让管理者每天都看得见

如果企业不能每天看见 AI 消耗结构,那就谈不上真正管理。

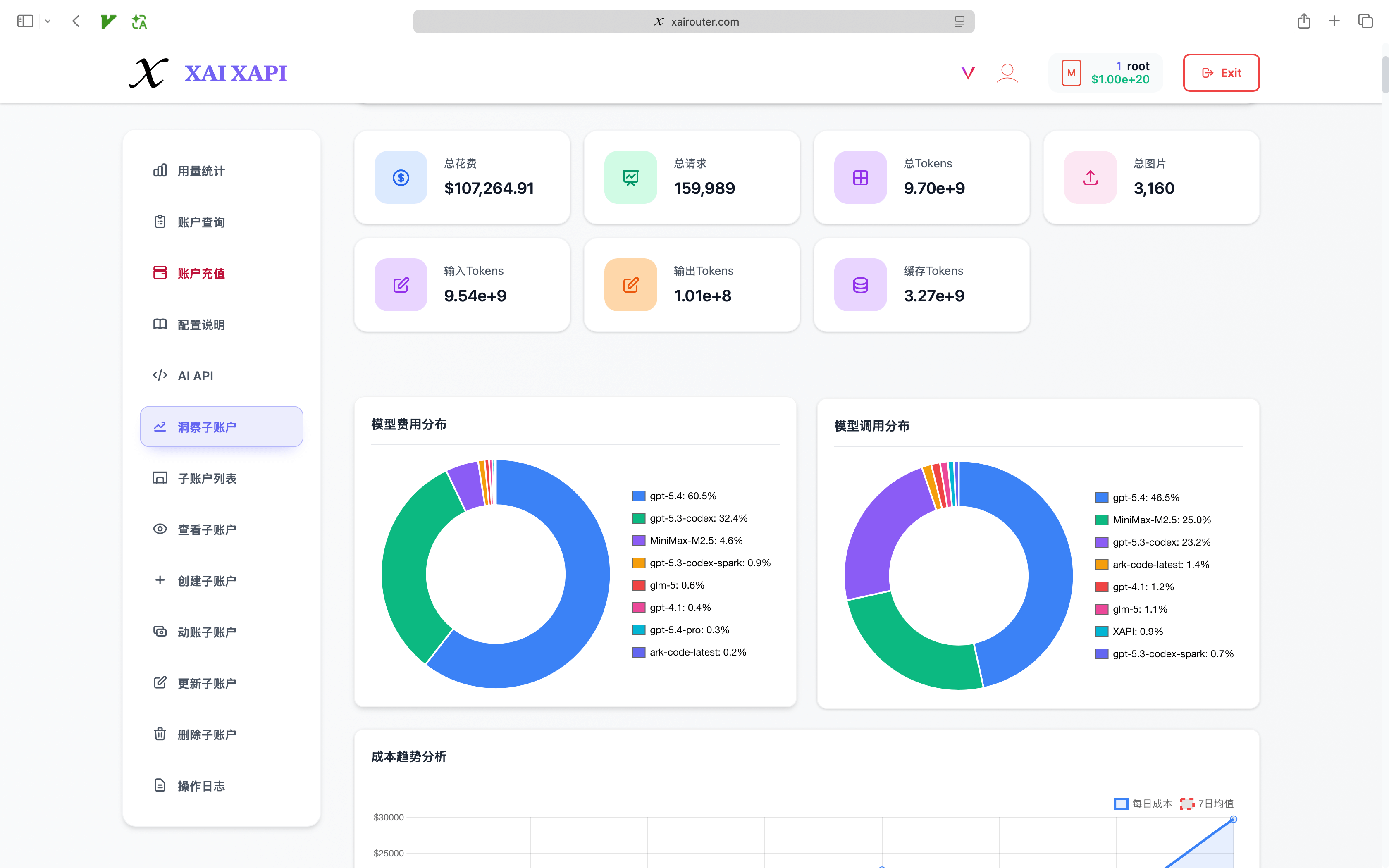

当前 XAI 的账户管理端已经不仅仅是“查余额”,而是在朝着一个日常运营控制台演进:

- 今日额度状态:直接展示当天 RPD、TPD、日额度、卡包使用进度。

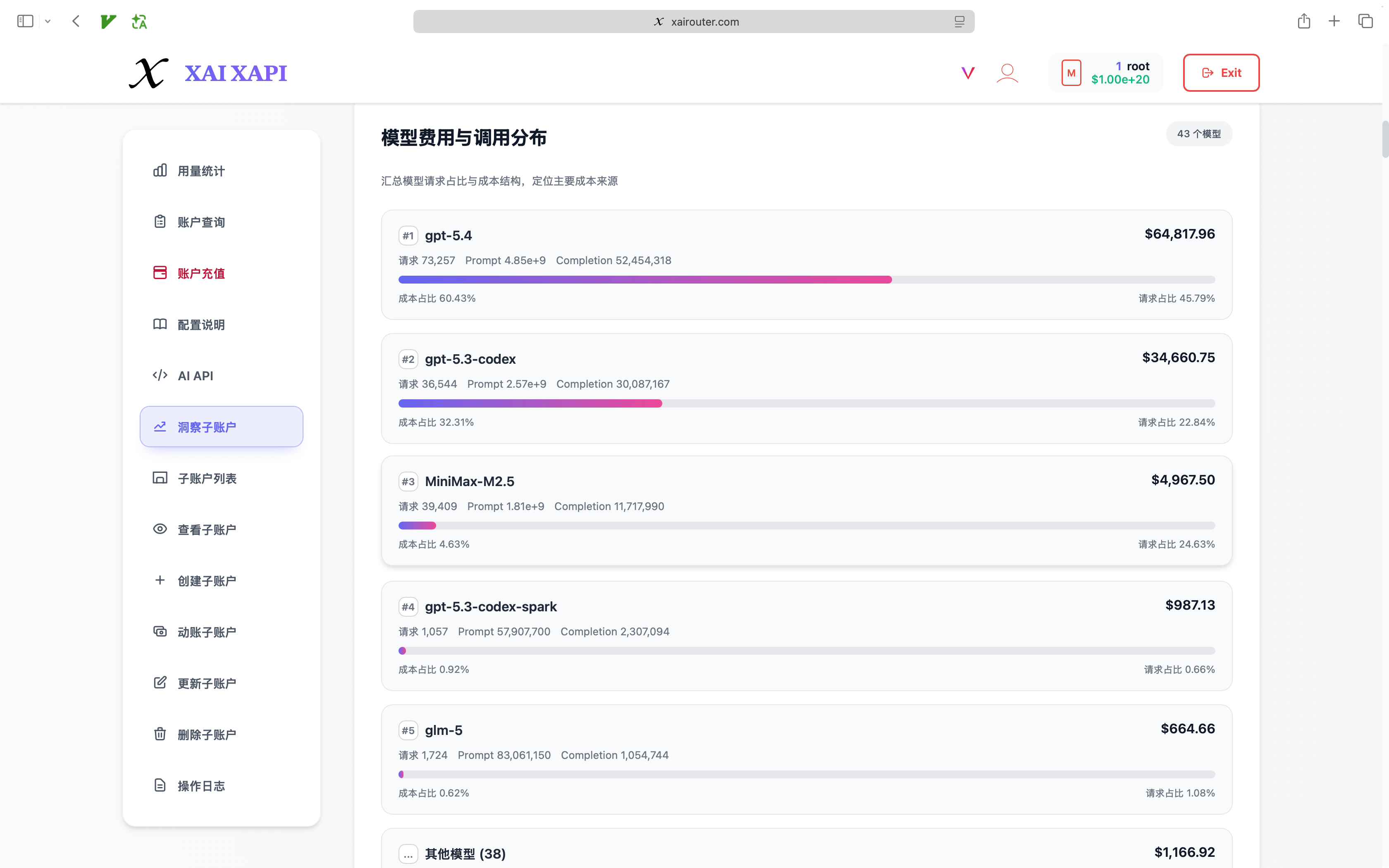

- 按用户/按模型统计:可以查看员工、子账户、模型维度的请求量、token 消耗与费用结构。

- 账单洞察面板:展示总成本、总请求数、总 tokens、prompt tokens、completion tokens、cache tokens、图像调用等关键指标。

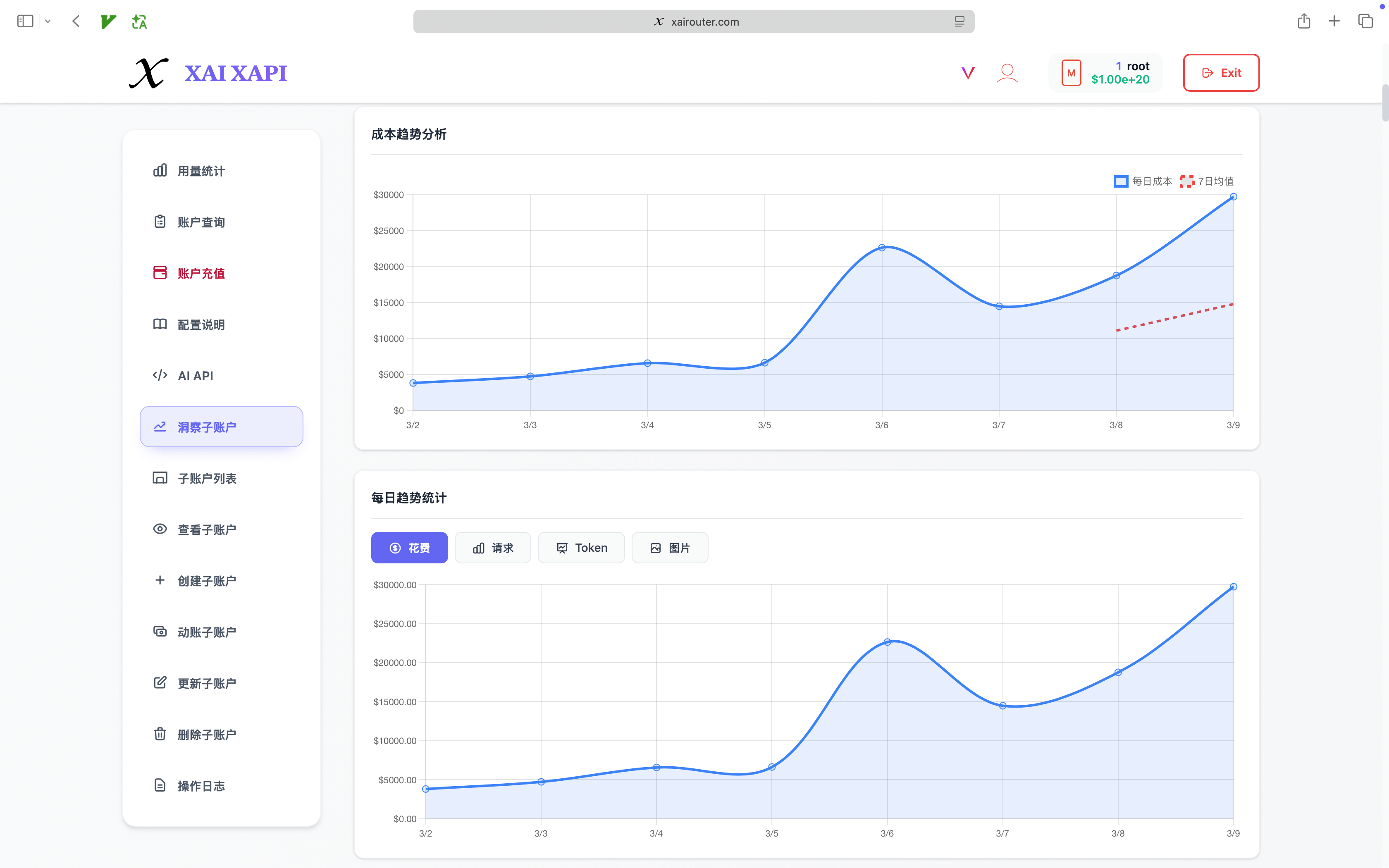

- 模型分布与趋势图:管理层可以看到哪些模型在消耗预算,哪些模型调用量高但价值不高,哪些场景适合继续优化映射策略。

- 子账户排行与异常发现:同一时间窗口下对比不同子账户的请求和花费,快速识别异常使用和资源浪费。

- 每日账单明细:从月度总账下钻到每日趋势,方便结合运营活动、发布节奏和团队工作负载做分析。

更重要的是,统计并不只记录表面的请求数。系统内部已经在跟踪更细的 usage 结构,例如:

prompt_tokenscompletion_tokensreasoning_tokenscached_tokens- 按模型聚合的 usage 细分

这意味着老板和管理者未来能回答的不再只是“这个月 AI 花了多少钱”,而是:

- 哪个部门在高质量使用 AI?

- 哪些员工主要把 AI 用在代码、文档、搜索还是图像?

- 哪些模型命中缓存更高,适合承接重复性工作?

- 哪些请求应该继续走高端模型,哪些应该回落到低成本模型?

真正的数据价值,不是做一个漂亮图表,而是让治理动作可以闭环。

7. 从老板视角看,XAI Router 解决的不是接口问题,而是经营问题

如果把企业老板最关心的 AI 管理痛点压缩成几句话,大致就是:

- AI 已经进公司了,但使用方式是失控的

- 预算正在增长,但收益看不清

- 员工在用不同工具,但缺少统一治理

- API Key 很敏感,但现在还靠人工传递

- 管理层想提效,但缺少每天都能看的数据面板

XAI Router 对应给出的,不是一组分散功能,而是一条完整链路:

- 统一入口:先把所有 AI 请求收口

- 统一身份与组织结构:再把请求映射到人、团队、部门

- 统一策略:把模型权限、资源边界、速率和预算固化下来

- 统一路由:让不同模型、不同供应商、不同官方工具链在一个治理框架下运行

- 统一计量:把 token、请求、图像、搜索、缓存等 usage 变成可分析数据

- 统一运营:最后让老板、IT、财务、业务负责人都能看到自己该看的那一层

这时,AI 才真正从“部门自发尝试的软件工具”,变成“企业可以长期经营的生产力系统”。

结语:它更像企业 AI 的中控台,而不是单纯网关

XAI Router 的架构价值,在于把性能、路由、安全、分发、计量和组织治理放进同一个系统里。

对开发者来说,它当然是一个高性能 AI API Router。

但对企业管理者来说,它更接近于:

- 一个统一的 AI 接入中心

- 一个 AI tokens 分发系统

- 一个 AI API Key 安全治理层

- 一个员工日常 AI 使用统计与预算运营平台

当企业开始同时接入 OpenAI、Anthropic、Gemini、DeepSeek、MiniMax,以及 Codex、Claude Code、Agent SDK 等不同工具链时,这种“统一控制平面 + 多协议桥接 + 精细计量”的架构,才是把 AI 真正用进组织里的关键。

XAI Router 不是为了让请求“能转发出去”,而是为了让企业知道:谁在用、怎么用、该给谁更多资源、该在哪些地方收紧边界,以及怎样把 AI 投入转化成持续的组织效率。